水平拡張

概要

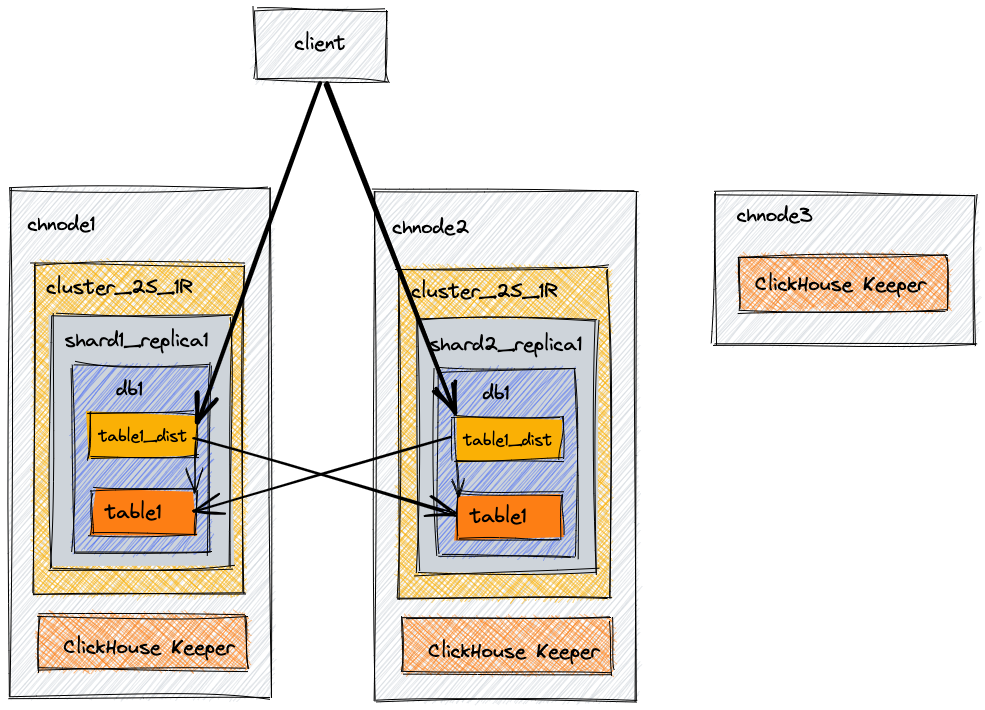

この例のアーキテクチャは、スケーラビリティを提供するように設計されています。こちらには3つのノードが含まれています:2つのClickHouseとコーディネーション(ClickHouse Keeper)サーバーが組み合わさったもの、およびこのクォーラムを完成させるためのClickHouse Keeperのみを持つ3番目のサーバーです。この例を使用して、データベース、テーブル、および2つのノードの両方でデータをクエリできる分散テーブルを作成します。

レベル: 基本

用語集

レプリカ

データのコピー。ClickHouseは常にデータの少なくとも1つのコピーを持っているため、レプリカの最小数は1です。これは重要なポイントで、元のデータをレプリカとして数えることに慣れていないかもしれませんが、ClickHouseのコードとドキュメントではその用語が使用されています。データの2番目のレプリカを追加することで、フォールトトレランスを提供できます。

シャード

データのサブセット。ClickHouseは常にデータの少なくとも1つのシャードを持っているので、データを複数のサーバーに分散しない場合、データは1つのシャードに格納されます。データを複数のサーバーに分散してシャーディングすることは、単一サーバーの容量を超えた場合に負荷を分散するために利用できます。宛先サーバーはシャーディングキーによって決まり、分散テーブルを作成する際に定義されます。シャーディングキーはランダムなものか、ハッシュ関数の出力として定義することができます。シャーディングを含むデプロイメント例では、シャーディングキーとしてrand()を使用し、いつどのようにして異なるシャーディングキーを選択するかについてのさらなる情報を提供します。

分散調整

ClickHouse Keeperは、データのレプリケーションと分散DDLクエリの実行のための調整システムを提供します。ClickHouse KeeperはApache ZooKeeperと互換性があります。

環境

アーキテクチャ図

| ノード | 説明 |

|---|---|

| chnode1 | データ + ClickHouse Keeper |

| chnode2 | データ + ClickHouse Keeper |

| chnode3 | ClickHouse Keeperクォーラムに使用 |

本番環境では、ClickHouse Keeperを専用ホストで実行することを強くお勧めします。この基本構成では、ClickHouse Serverプロセス内でKeeper機能を実行しています。ClickHouse Keeperをスタンドアロンでデプロイする手順は、インストールドキュメントで確認できます。

インストール

3つのサーバーにClickhouseをインストールし、アーカイブタイプごとの手順 (.deb, .rpm, .tar.gzなど) に従ってください。この例では、3台のマシンすべてにClickHouse ServerとClientのインストール手順に従います。

設定ファイルの編集

ClickHouse Server を設定する際、設定ファイルを追加または編集するときは次のようにしてください:

- ファイルを

/etc/clickhouse-server/config.d/ディレクトリに追加する - ファイルを

/etc/clickhouse-server/users.d/ディレクトリに追加する /etc/clickhouse-server/config.xmlファイルはそのままにしておく/etc/clickhouse-server/users.xmlファイルはそのままにしておく

chnode1の設定

chnode1には、5つの設定ファイルがあります。これらのファイルを1つのファイルにまとめることもできますが、ドキュメント内で個別に見る方が明確かもしれません。設定ファイルを読み進めると、chnode1とchnode2のほとんどの設定が同じであることがわかります。一部の違いは強調されます。

ネットワークとログ設定

これらの値は、お好みでカスタマイズできます。この例の設定は、1000Mで3回ロールオーバーするデバッグログを提供します。ClickHouseはIPv4ネットワークでポート8123と9000でリッスンし、インターサーバー通信にポート9009を使用します。

<clickhouse>

<logger>

<level>debug</level>

<log>/var/log/clickhouse-server/clickhouse-server.log</log>

<errorlog>/var/log/clickhouse-server/clickhouse-server.err.log</errorlog>

<size>1000M</size>

<count>3</count>

</logger>

<display_name>clickhouse</display_name>

<listen_host>0.0.0.0</listen_host>

<http_port>8123</http_port>

<tcp_port>9000</tcp_port>

<interserver_http_port>9009</interserver_http_port>

</clickhouse>

ClickHouse Keeper設定

ClickHouse Keeperは、データレプリケーションと分散DDLクエリの実行のためのコーディネーションシステムを提供します。ClickHouse KeeperはApache ZooKeeperと互換性があります。この設定では、ポート9181でClickHouse Keeperを有効にします。強調表示されている行は、Keeperのインスタンスにserver_idを1としていることを示しています。このenable-keeper.xmlファイルの違いは3つのサーバーすべてでこれだけです。chnode2ではserver_idは2に設定され、chnode3ではserver_idは3に設定されます。raft構成セクションは3つのサーバーすべてで同じであり、下記に強調されて、server_idとraft構成内のserverインスタンスの関係を示します。

何らかの理由でKeeperノードが交換または再構築された場合、既存のserver_idを再利用しないでください。例えば、server_idが2であるKeeperノードが再構築された場合は、server_idを4以上にしてください。

<clickhouse>

<keeper_server>

<tcp_port>9181</tcp_port>

<server_id>1</server_id>

<log_storage_path>/var/lib/clickhouse/coordination/log</log_storage_path>

<snapshot_storage_path>/var/lib/clickhouse/coordination/snapshots</snapshot_storage_path>

<coordination_settings>

<operation_timeout_ms>10000</operation_timeout_ms>

<session_timeout_ms>30000</session_timeout_ms>

<raft_logs_level>trace</raft_logs_level>

</coordination_settings>

<raft_configuration>

<server>

<id>1</id>

<hostname>chnode1</hostname>

<port>9234</port>

</server>

<server>

<id>2</id>

<hostname>chnode2</hostname>

<port>9234</port>

</server>

<server>

<id>3</id>

<hostname>chnode3</hostname>

<port>9234</port>

</server>

</raft_configuration>

</keeper_server>

</clickhouse>

マクロ設定

マクロshardとreplicaにより、分散DDLの複雑さが軽減されます。設定された値はDDLクエリ内で自動的に置き換えられるため、DDLを簡素化できます。この設定のマクロは、各ノードのシャードとレプリカ番号を指定します。この2シャード1レプリカの例では、レプリカマクロはchnode1とchnode2の両方でreplica_1に設定されています。シャードマクロはchnode1では1、chnode2では2です。

<clickhouse>

<macros>

<shard>1</shard>

<replica>replica_1</replica>

</macros>

</clickhouse>

レプリケーションとシャーディング設定

以下の設定の大まかな概要です:

- XMLの

remote_serversセクションは、環境内の各クラスターを指定します。属性replace=trueは、デフォルトのClickHouse設定のサンプルremote_serversをこのファイルで指定されたremote_servers設定で置き換えます。この属性がない場合、このファイル内のリモートサーバーはデフォルトのサンプルリストに追加されます。 - この例では、1つのクラスターが

cluster_2S_1Rという名前で存在します。 - クラスター

cluster_2S_1Rのためのシークレットがmysecretphraseという値で作成されます。環境内のすべてのリモートサーバー間でシークレットが共有され、正しいサーバーが一緒に結合されることを保証します。 - クラスター

cluster_2S_1Rには2つのシャードがあり、それぞれのシャードに1つのレプリカがあります。文書の冒頭近くのアーキテクチャ図を見て、以下のXMLの2つのshard定義と比較してください。各シャード定義には1つのレプリカがあります。レプリカは特定のシャード用です。レプリカのホストとポートが指定されています。最初のシャードの設定のレプリカはchnode1に保存され、2番目のシャードの設定のレプリカはchnode2に保存されます。 - シャードの内部レプリケーションはtrueに設定されています。各シャードは設定ファイルで

internal_replicationパラメーターを定義することができ、このパラメーターがtrueに設定されている場合、書き込み操作は最初の正常なレプリカを選択し、データを書き込みます。

<clickhouse>

<remote_servers replace="true">

<cluster_2S_1R>

<secret>mysecretphrase</secret>

<shard>

<internal_replication>true</internal_replication>

<replica>

<host>chnode1</host>

<port>9000</port>

</replica>

</shard>

<shard>

<internal_replication>true</internal_replication>

<replica>

<host>chnode2</host>

<port>9000</port>

</replica>

</shard>

</cluster_2S_1R>

</remote_servers>

</clickhouse>

Keeperの使用設定

上でClickHouse Keeperが設定されました。この設定ファイルuse-keeper.xmlは、レプリケーションと分散DDLのコーディネーションのためにClickHouse ServerがClickHouse Keeperを使用する設定を行っています。このファイルは、ClickHouse Serverがポート9181でchnode1から3のKeeperを使用するように指定しており、ファイルはchnode1とchnode2で同じです。

<clickhouse>

<zookeeper>

<node index="1">

<host>chnode1</host>

<port>9181</port>

</node>

<node index="2">

<host>chnode2</host>

<port>9181</port>

</node>

<node index="3">

<host>chnode3</host>

<port>9181</port>

</node>

</zookeeper>

</clickhouse>

chnode2の設定

chnode1とchnode2の設定は非常に似ているため、ここでは違いのみを指摘します。

ネットワークとログ設定

<clickhouse>

<logger>

<level>debug</level>

<log>/var/log/clickhouse-server/clickhouse-server.log</log>

<errorlog>/var/log/clickhouse-server/clickhouse-server.err.log</errorlog>

<size>1000M</size>

<count>3</count>

</logger>

<display_name>clickhouse</display_name>

<listen_host>0.0.0.0</listen_host>

<http_port>8123</http_port>

<tcp_port>9000</tcp_port>

<interserver_http_port>9009</interserver_http_port>

</clickhouse>

ClickHouse Keeper設定

このファイルにはchnode1とchnode2の違いの一つが含まれています。Keeperの設定でserver_idが2に設定されています。

<clickhouse>

<keeper_server>

<tcp_port>9181</tcp_port>

<server_id>2</server_id>

<log_storage_path>/var/lib/clickhouse/coordination/log</log_storage_path>

<snapshot_storage_path>/var/lib/clickhouse/coordination/snapshots</snapshot_storage_path>

<coordination_settings>

<operation_timeout_ms>10000</operation_timeout_ms>

<session_timeout_ms>30000</session_timeout_ms>

<raft_logs_level>trace</raft_logs_level>

</coordination_settings>

<raft_configuration>

<server>

<id>1</id>

<hostname>chnode1</hostname>

<port>9234</port>

</server>

<server>

<id>2</id>

<hostname>chnode2</hostname>

<port>9234</port>

</server>

<server>

<id>3</id>

<hostname>chnode3</hostname>

<port>9234</port>

</server>

</raft_configuration>

</keeper_server>

</clickhouse>

マクロ設定

マクロ設定にはchnode1とchnode2の違いの一つがあります。shardはこのノードでは2に設定されています。

<clickhouse>

<macros>

<shard>2</shard>

<replica>replica_1</replica>

</macros>

</clickhouse>

レプリケーションとシャーディング設定

<clickhouse>

<remote_servers replace="true">

<cluster_2S_1R>

<secret>mysecretphrase</secret>

<shard>

<internal_replication>true</internal_replication>

<replica>

<host>chnode1</host>

<port>9000</port>

</replica>

</shard>

<shard>

<internal_replication>true</internal_replication>

<replica>

<host>chnode2</host>

<port>9000</port>

</replica>

</shard>

</cluster_2S_1R>

</remote_servers>

</clickhouse>

Keeperの使用設定

<clickhouse>

<zookeeper>

<node index="1">

<host>chnode1</host>

<port>9181</port>

</node>

<node index="2">

<host>chnode2</host>

<port>9181</port>

</node>

<node index="3">

<host>chnode3</host>

<port>9181</port>

</node>

</zookeeper>

</clickhouse>

chnode3の設定

chnode3はデータを保存せず、ClickHouse Keeperがクォーラムの3番目のノードを提供するために使用されているため、chnode3には、ネットワークとログを設定するファイルとClickHouse Keeperを設定するファイルの2つの設定ファイルのみがあります。

ネットワークとログ設定

<clickhouse>

<logger>

<level>debug</level>

<log>/var/log/clickhouse-server/clickhouse-server.log</log>

<errorlog>/var/log/clickhouse-server/clickhouse-server.err.log</errorlog>

<size>1000M</size>

<count>3</count>

</logger>

<display_name>clickhouse</display_name>

<listen_host>0.0.0.0</listen_host>

<http_port>8123</http_port>

<tcp_port>9000</tcp_port>

<interserver_http_port>9009</interserver_http_port>

</clickhouse>

ClickHouse Keeper設定

<clickhouse>

<keeper_server>

<tcp_port>9181</tcp_port>

<server_id>3</server_id>

<log_storage_path>/var/lib/clickhouse/coordination/log</log_storage_path>

<snapshot_storage_path>/var/lib/clickhouse/coordination/snapshots</snapshot_storage_path>

<coordination_settings>

<operation_timeout_ms>10000</operation_timeout_ms>

<session_timeout_ms>30000</session_timeout_ms>

<raft_logs_level>trace</raft_logs_level>

</coordination_settings>

<raft_configuration>

<server>

<id>1</id>

<hostname>chnode1</hostname>

<port>9234</port>

</server>

<server>

<id>2</id>

<hostname>chnode2</hostname>

<port>9234</port>

</server>

<server>

<id>3</id>

<hostname>chnode3</hostname>

<port>9234</port>

</server>

</raft_configuration>

</keeper_server>

</clickhouse>

テスト

chnode1に接続し、上で設定されたクラスターcluster_2S_1Rが存在することを確認します。

SHOW CLUSTERS

┌─cluster───────┐

│ cluster_2S_1R │

└───────────────┘

- クラスター上にデータベースを作成します。

CREATE DATABASE db1 ON CLUSTER cluster_2S_1R

┌─host────┬─port─┬─status─┬─error─┬─num_hosts_remaining─┬─num_hosts_active─┐

│ chnode2 │ 9000 │ 0 │ │ 1 │ 0 │

│ chnode1 │ 9000 │ 0 │ │ 0 │ 0 │

└─────────┴──────┴────────┴───────┴─────────────────────┴──────────────────┘

- クラスター上にMergeTreeテーブルエンジンを使用したテーブルを作成します。Note

テーブルエンジンのパラメーターを指定する必要はありません。これらはマクロに基づいて自動的に定義されます。

CREATE TABLE db1.table1 ON CLUSTER cluster_2S_1R

(

`id` UInt64,

`column1` String

)

ENGINE = MergeTree

ORDER BY id

┌─host────┬─port─┬─status─┬─error─┬─num_hosts_remaining─┬─num_hosts_active─┐

│ chnode1 │ 9000 │ 0 │ │ 1 │ 0 │

│ chnode2 │ 9000 │ 0 │ │ 0 │ 0 │

└─────────┴──────┴────────┴───────┴─────────────────────┴──────────────────┘

chnode1に接続して1行を挿入します。

INSERT INTO db1.table1 (id, column1) VALUES (1, 'abc');

chnode2に接続して1行を挿入します。

INSERT INTO db1.table1 (id, column1) VALUES (2, 'def');

chnode1またはchnode2のどちらかに接続し、そのノードのテーブルに挿入された行のみが表示されることを確認します。 例えば、chnode2で

SELECT * FROM db1.table1;

┌─id─┬─column1─┐

│ 2 │ def │

└────┴─────────┘

- 両方のノードで両方のシャードをクエリする分散テーブルを作成します。

(この例では、

rand()関数をシャーディングキーとして設定し、各挿入をランダムに分散させます)

CREATE TABLE db1.table1_dist ON CLUSTER cluster_2S_1R

(

`id` UInt64,

`column1` String

)

ENGINE = Distributed('cluster_2S_1R', 'db1', 'table1', rand())

┌─host────┬─port─┬─status─┬─error─┬─num_hosts_remaining─┬─num_hosts_active─┐

│ chnode2 │ 9000 │ 0 │ │ 1 │ 0 │

│ chnode1 │ 9000 │ 0 │ │ 0 │ 0 │

└─────────┴──────┴────────┴───────┴─────────────────────┴──────────────────┘

chnode1またはchnode2に接続し、両方の行を確認するために分散テーブルをクエリします。

SELECT * FROM db1.table1_dist;

┌─id─┬─column1─┐

│ 2 │ def │

└────┴─────────┘

┌─id─┬─column1─┐

│ 1 │ abc │

└────┴─────────┘